スマートフォンでの夜景撮影は年々進化していますが、極端に暗い環境では今も限界があります。そうした中、Appleの研究チームが、AIをカメラの画像処理そのものに組み込むことで、暗所写真の品質を大幅に改善できる可能性を示しました。

暗すぎる写真で起きていた問題点

照明がほとんどない場所で撮影すると、写真全体にザラついたノイズが目立つ経験をした人も多いはずです。これは、センサーが十分な光を捉えられないことが原因です。

これまでAppleを含む多くのメーカーは、後処理によるノイズ除去で対応してきましたが、その結果として細部が失われ、絵画のようにのっぺりとした描写になることもありました。暗所撮影では、ノイズ除去とディテール保持の両立が大きな課題となっていました。

拡散モデルをISPに組み込む新アプローチ

この課題に対し、Appleと米パデュー大学の研究者が共同で開発したのが「DarkDiff」と呼ばれる技術です。特徴的なのは、AIを撮影後の加工ではなく、カメラの画像信号処理(ISP)の流れに直接組み込んだ点にあります。

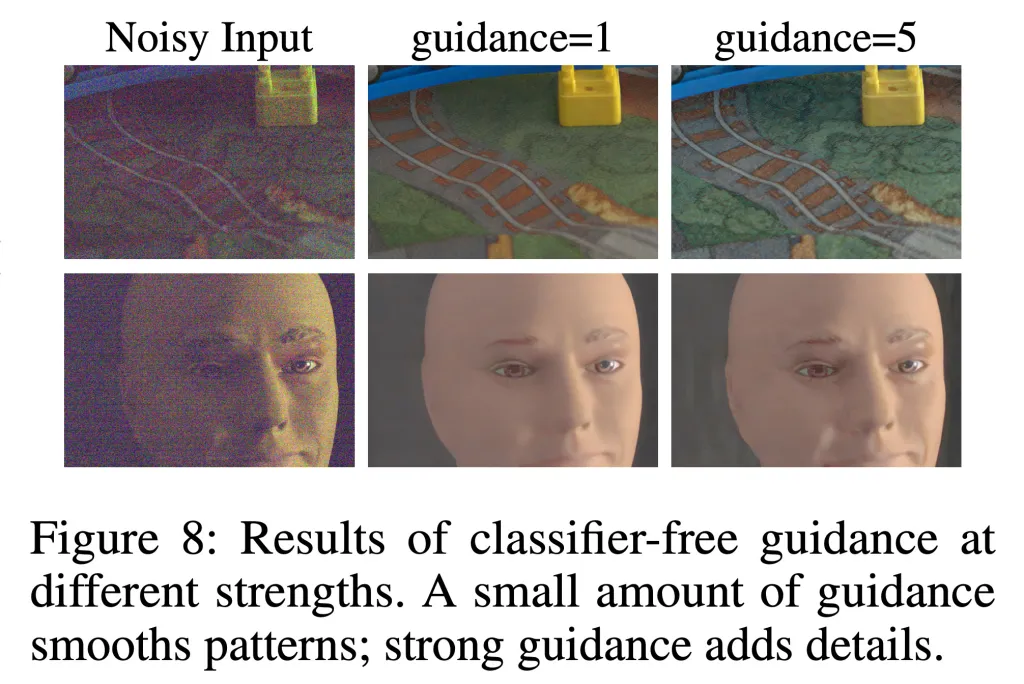

DarkDiffでは、事前に大量の画像で学習された生成系の拡散モデルを活用し、暗い部分に本来存在するはずの情報を文脈から推定します。これにより、単なるノイズ除去ではなく、構造や質感を保ったまま暗所を補正できるとしています。

ハルシネーションを抑える仕組みも導入

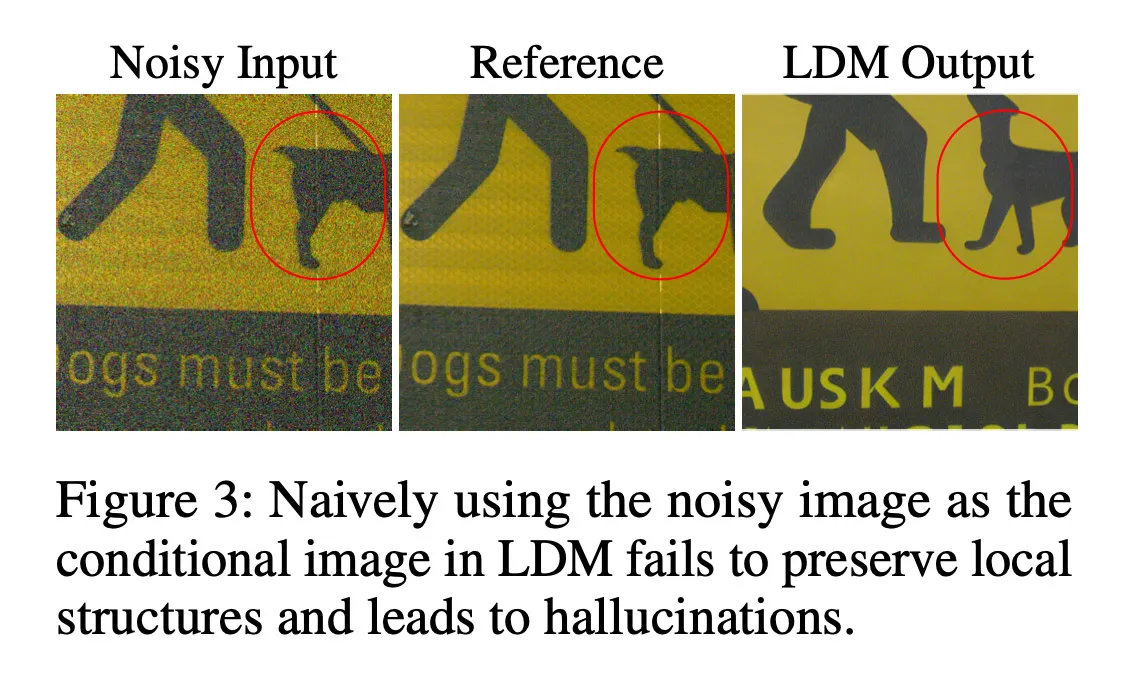

AIによる画像生成では、実際には存在しない模様や形を作り出してしまう、いわゆるハルシネーションが問題になることがあります。DarkDiffでは、画像を細かな領域に分けて注意を向ける仕組みを導入し、局所的な構造を維持することで不自然な生成を抑えています。

処理の流れとしては、ホワイトバランスやデモザイク処理などの初期工程は従来どおりISPが担当し、その後にDarkDiffが線形RGB画像を処理して最終的なsRGB画像を生成します。

実写テストでは長時間露光に迫る結果も

研究では、Sony A7S IIなどのカメラを用いて、極端に暗い環境で実際に撮影した写真を使用しています。シャッター速度は最短で0.033秒という条件で撮影され、その結果を、三脚を使って約300倍長い露光時間で撮影した参照画像と比較しました。

その結果、DarkDiffは既存のRAW補正モデルや他の拡散モデルを上回る視覚的品質を示したとされています。

実用化には課題も残る

一方で、課題がないわけではありません。研究者によると、この処理は従来の手法より計算負荷が大きく、スマートフォン上で実行するとバッテリー消費が問題になる可能性があります。現実的にはクラウド処理が必要になる場面も考えられます。

また、暗所で撮影された文字、とくに英語以外の文字認識には制約がある点も指摘されています。現時点で、この技術が近い将来iPhoneに搭載されると明言されているわけではありません。

それでも今回の研究は、Appleが計算写真技術を引き続き重視していることを示すものです。ハードウェアの物理的制約が厳しくなる中、AIによる画像処理の進化がスマートフォンカメラの差別化を左右する時代は、ますます加速していきそうです。