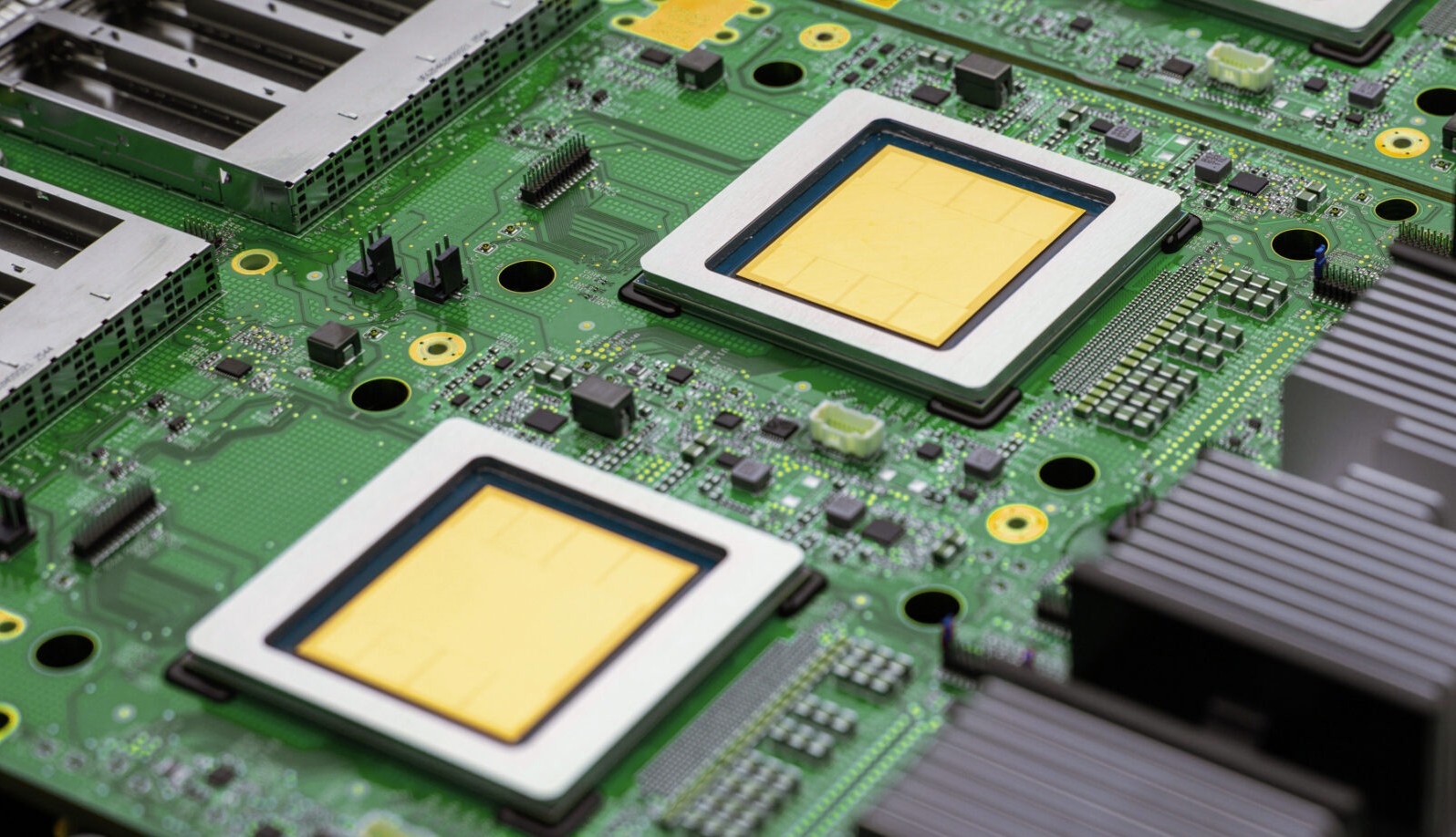

Googleは次世代のAIインフラを支える新しいTensor Processing Unitを発表しました。今回の特徴は、従来のような単一の進化ではなく、用途別に最適化された2種類のチップを用意した点にあります。AIがより高度に活用される「エージェント時代」を見据えた設計とされています。

学習専用チップTPU 8tで開発期間を大幅短縮

新たに登場したTPU 8tは、AIモデルの学習に特化したチップです。大規模モデルのトレーニング期間を従来の数カ月単位から数週間レベルへ短縮することを目指して設計されています。

このチップは大規模なサーバークラスターで運用され、1つのクラスタには最大9,600個のチップと約2ペタバイトの共有メモリを搭載。さらに理論上は最大100万個規模まで拡張可能とされており、極めて大規模なAIモデルの開発にも対応します。

また、計算効率の高さも特徴で、消費電力あたりの実効性能が大幅に向上。メモリアクセスの最適化や障害時の自動対応などにより、無駄の少ない学習処理を実現しています。

推論に最適化されたTPU 8iで効率運用

一方、学習済みモデルを実際に動かす「推論」処理に特化したのがTPU 8iです。AIサービスの応答や生成処理に使われるこちらのチップは、より省電力かつ効率的に動作する設計となっています。

TPU 8iはオンチップメモリを大幅に増強し、長い文脈を扱うAI処理でも高速化を実現。さらに複数のAIエージェントを同時に動かす場面でも待ち時間を抑え、スムーズな処理が可能とされています。

ARMベース設計とデータセンター最適化

今回の第8世代TPUでは、ホストCPUにも変化があり、Google独自のARMベースCPUを全面採用しています。これにより、チップ全体の効率が向上し、従来よりも高いパフォーマンスを実現しているといいます。

また、データセンター側の設計も見直されており、ネットワークと演算機能の統合やラック配置の最適化などにより、電力あたりの計算能力は従来比で最大6倍に向上したとされています。

消費電力と冷却効率の改善も

AIの普及に伴い問題視されている電力消費についても、今回のTPUでは改善が図られています。Googleによると、新チップは前世代比でワットあたりの性能が約2倍に向上しています。

さらに冷却面では液体冷却システムを進化させ、負荷に応じて水流を調整する仕組みを導入。効率的な熱処理によって、データセンター全体の運用効率を高めています。

AI競争激化の中での独自路線

多くの企業がNVIDIA製AIアクセラレータに依存する中、Googleは自社開発チップによる独自戦略を継続しています。今回のTPU 8tと8iは、自社AIであるGeminiの強化だけでなく、外部開発者向けのプラットフォームとしても活用される見込みです。

AIインフラの効率化は依然として大きな課題ですが、今回の発表はその解決に向けた一歩と言えそうです。今後、こうした専用チップの進化がAIサービスの性能やコストにどのような影響を与えるのか、引き続き注目されます。